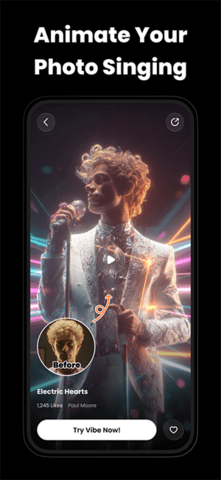

VibeMe是一款基于深度学习和计算机视觉技术开发的创新型多媒体内容生成应用,其核心功能在于将静态的含有人脸元素的数字图像,通过先进的AI算法,智能地转化为具有动态表演效果(如唱歌、跳舞)的短视频。软件通过解析图像中的面部特征、表情及姿态信息,并驱动预构建的3D面部模型与口型同步系统,生成高度拟人化的动画序列,从而为普通照片注入生动的数字生命。其技术流程涵盖了从图像预处理、人脸检测与关键点定位、到动作迁移与音频同步渲染等一系列复杂计算,最终输出一段可分享的、富有创意和娱乐性的短视频内容。软件降低了动态内容创作的技术门槛,使得不具备专业动画或视频编辑技能的用户,也能便捷地生成个性化动态影像,满足了社交媒体时代用户对新颖、趣味性UGC(用户生成内容)的广泛需求。

VibeMe软件特色介绍

VibeMe的核心特色在于其技术集成度与用户体验的平衡,主要体现在以下四个对用户具有显著价值的方面:

第一,高精度的人脸特征解析与动作迁移技术。软件采用经过海量数据训练的卷积神经网络(CNN)模型进行人脸检测与对齐,能够精准识别照片中面部超过百个关键特征点。在此基础上,其动作迁移算法并非简单的贴图动画,而是通过分析目标音频的节奏、音高和音素,驱动一个参数化的面部绑定模型,实现高度逼真的口型同步与表情微动。生成的动画不仅嘴唇开合与歌词匹配,还会伴随音乐节奏产生自然的头部微摆和表情变化,极大地提升了生成内容的真实感与感染力。

第二,模块化与可扩展的音频-视觉合成管线。VibeMe内置的音频库并非简单的背景音乐集合,而是一个与视觉动作模板深度绑定的资源系统。每一段推荐音频都预关联了特定的动作序列、节奏模板和视觉特效参数。当用户选择某段音乐时,系统会自动调用与之匹配的最佳动画参数集,确保生成的视频在节奏卡点、动作幅度与音乐情绪上达到高度协调。这种设计保证了即使是非专业用户,也能通过简单的选择-生成操作,产出在视听层面具备专业协调性的作品。

第三,基于风格迁移与条件生成对抗网络(cGAN)的特效模板。软件提供的多样化特效模板,其底层是多种风格迁移算法和视觉滤镜的组合应用。将照片转化为素描风格再动画化,或为视频叠加特定的光影粒子效果,这些功能依赖于cGAN等生成式AI模型。用户选择不同模板,实质上是为生成过程设定了不同的视觉风格条件,模型会据此重新渲染每一帧画面,确保动态效果与所选风格无缝融合,从而创造出从复古胶片到赛博朋克等多种视觉语境的创意视频,满足了用户的个性化表达需求。

第四,端到端的云端协同处理架构。为了平衡计算复杂度与移动端性能,VibeMe采用了混合计算架构。人脸检测和初步的图像优化在本地设备完成,以保障用户隐私和响应速度;而耗时的深度神经网络推理、高精度动作生成与视频编码合成等任务,则交由云端服务器集群处理。这种架构确保了即使在硬件性能有限的设备上,用户也能在较短时间内获得高质量的输出结果,软件能够持续集成更庞大、更先进的AI模型而无需用户频繁更新客户端,为功能的持续迭代升级提供了技术基础。

VibeMe软件功能

VibeMe的具体功能围绕其核心技术栈构建,系统性解决用户从素材准备到成品分享全流程中的痛点:

智能人脸检测与素材适配: 该功能针对用户上传非标准或质量参差照片导致生成失败的核心痛点。软件的人脸检测模块具备较强的鲁棒性,能够处理一定程度的侧脸、遮挡(如眼镜)和光照不均的情况。它不仅能识别单张照片中的单人或多人面孔,还能对照片质量进行初步评估,如清晰度、对比度等,并给出优化建议或进行自动增强。这解决了用户因使用模糊、过暗或无人脸照片而导致创作流程中断的问题,确保了输入素材的有效性。

多维度音频-动作映射选择: 针对用户难以自行将音乐与动画动作匹配的痛点,软件将音频库按音乐流派(如流行、摇滚、电子)、节奏(BPM)和情绪(欢快、舒缓、搞怪)进行了精细化分类和标签化。每个音频选项都直观展示了其对应的典型动画风格预览(如活力舞蹈、深情演唱、可爱摇摆)。用户无需理解复杂的动画原理,只需根据自己想要达成的视频氛围进行选择,系统即自动完成从音频特征到复杂动作序列的映射,极大简化了创作决策过程。

参数化特效与风格化渲染: 此功能解决用户希望视频具备独特视觉风格但缺乏专业调色或后期技能的问题。除了预设模板,部分高级功能允许用户对特定参数进行微调,动画的夸张程度、背景虚化效果、色彩饱和度等。通过提供这些可控的风格滑块,在模板的基础上进行二次创作,使生成的作品更具个人特色,避免了千篇一律的模板化输出。

一体化渲染与多渠道分发: 生成完成后,软件提供多种分辨率和格式的输出选项(如适用于Instagram的方形视频、适用于TikTok的竖屏视频),并内置一键分享至主流社交平台(如微信、抖音、Instagram、YouTube等)的接口。这解决了用户需要额外使用视频编辑软件进行格式转换和裁剪,以及在不同应用间频繁切换才能完成分享的繁琐流程,实现了创作到分发的无缝闭环,提升了分享的即时性和便利性。

离线队列与后台生成: 针对视频生成可能耗时较长,占用用户手机前台的问题,软件支持任务队列和后台生成功能。用户可连续添加多个创作任务,软件会按顺序在后台进行处理。在生成过程中切换至其他应用,待完成后通过通知提醒查看结果。这优化了用户的时间利用,尤其适合需要批量处理多张照片的用户场景。

未来前景与技术演进

展望未来,VibeMe所依托的静态图像动态化技术拥有广阔的发展潜力和多元化的应用前景。其技术演进可能沿着以下几个方向深入:

在技术层面,未来的迭代将实现更高保真度的动作生成与更广泛的内容理解。通过引入更强大的多模态预训练模型(如融合视觉、音频和文本理解的模型),软件将不仅能根据音乐生成动作,还能理解照片的场景上下文(如婚礼、派对、运动),从而生成更贴合场景情境的动画和剧情片段。一张毕业照可以生成抛帽庆祝的动画,一张运动照片可以生成对应的庆祝舞蹈。3D人脸重建与神经辐射场(NeRF)技术的结合,有望实现从单张照片生成可自由调节视角的3D头像,并驱动其进行表演,这将把动态化从2D平面视频推向沉浸式的3D体验。

在应用场景拓展上,该技术将超越个人娱乐范畴,进入更专业的领域。在教育行业,可将历史人物肖像转化为进行演讲或授课的视频,让历史教学更加生动;在市场营销领域,品牌可以将其吉祥物或代言人照片快速生成宣传短视频,降低内容制作成本;在数字人文领域,可用于博物馆让古典肖像画开口讲述自己的故事。甚至与AR(增强现实)技术结合,将动态化的家人照片投射到现实环境中,创造全新的互动纪念方式。

在交互与创作模式上,AI将从工具演变为协作伙伴。未来的VibeMe可能会集成基于自然语言处理的指令系统,通过语音或文字描述想要的动画效果(如让这个人跳一段优雅的华尔兹),AI直接理解并生成相应内容。用户反馈(如对生成视频某一部分的喜好)将被实时用于优化个性化模型,使系统越来越了解用户的审美偏好,实现真正的个性化内容生成。

从更宏观的视角看,VibeMe所代表的技术是迈向通用内容生成AI的一步。它展示了如何将离散的模态(图像、音频)通过AI进行创造性融合。随着算力的提升和算法的进步,这类技术最终可能发展成能够根据任意文本或想法,即时生成包含特定人物、动作、场景和音乐的完整短视频的通用平台,彻底重塑数字内容的创作与消费范式。对于当前用户而言,早期接触和使用此类应用,不仅是享受创意乐趣,也是在亲身体验和塑造未来人机交互与内容生成方式的演进过程。